Существует множество инструментов для генерации видео с помощью ИИ. Но какой из них лучший? На самом деле, ответить на этот вопрос непросто. Это связано с тем, что технологии развиваются настолько быстро, что крупные новые улучшения, кажется, появляются каждый месяц, если не каждую неделю. В этой статье мы сравним 10 самых популярных и актуальных на текущий момент инструментов, чтобы помочь вам выбрать приложение на свой вкус.

Зачем использовать генератор видео на основе ИИ?

Для развлечения и прибыли! Скорее всего, сейчас это в основном развлечение, хотя многие креативные студии, использующие ИИ, вкладывают миллионы, чтобы бросить вызов Голливуду, создавая реалистичные видеоролики. Их также используют для создания рекламных роликов, видео для YouTube, видео для социальных сетей и другого видеоконтента. Для профессиональных видеоредакторов использование инструментов генеративного видео на основе ИИ для создания совершенно новых вступительных кадров, замены отсутствующих вставок, создания фонов с зеленым экраном и других корректировок может значительно повысить ценность существующего проекта. Инструменты ИИ, безусловно, значительно экономят время при очистке звука для удаления фонового шума и других звуков, даже для тех, кто обладает высококлассными навыками видеомонтажа. Вы также можете использовать инструменты ИИ для редактирования видео.

Хотя у основных игроков есть свои собственные проприетарные модели, а именно на этом сегменте рынка мы сосредоточились в этом обзоре, многие генераторы видео на основе ИИ, такие как Magic Hour, обеспечивают качественные результаты, объединяя несколько моделей ИИ на одной платформе с различным интерфейсом и дополнительной платой за подписку. Большинство продвинутых инструментов ИИ теперь принимают эталонные изображения в качестве входных данных наряду с текстовым запросом. Это действительно помогает модели улучшать видеоконтент и повышать качество видео, обеспечивая согласованные, целостные и контролируемые результаты на основе изображения, которое уже выглядит так, как вам нужно.

Есть еще один нюанс — это разработка задания для генератора видео на базе ИИ. Мы рекомендуем использовать Perplexity.ai. Также, справедливости ради, стоит отметить, что некоторые задания для определенных моделей могут оказаться чрезмерно сложными.

Сравнение генераторов видео на основе ИИ

Практически все сервисы, за исключением Sora от Open AI, предлагают бесплатную пробную версию, и почти все они позволяют создавать видео из загруженных изображений, что обычно является лучшим способом доработки вашего видеоклипа. Это потому, что перегенерировать отдельные изображения гораздо дешевле, чем создавать заново целые видеоклипы. Поэтому оптимальный рабочий процесс — это довести до совершенства исходные кадры, прежде чем позволить ИИ добавить к нему движение, при этом точно указывая желаемое движение камеры.

Kling AI — это генеративная модель искусственного интеллекта, которая создает короткие реалистичные видеоролики из текстового описания или статичного изображения. Ее главная особенность — способность генерировать синхронизированный со картинкой звук, музыку и диалоги, что делает ее одним из самых продвинутых инструментов для автоматизации видеопродакшна наравне с Sora от Open AI и Veo 3 от Google.

Разработчик нейросети — китайская компания Kuaishou Technology. Это один из крупнейших в мире операторов платформ для коротких видео и прямой конкурент TikTok на внутреннем рынке Китая, что объясняет фокус модели на создании видеоконтента. Kling AI была анонсирована в июне 2024 года как ответ на тогда еще недоступную широкой аудитории модель Sora. За полтора года платформа прошла путь от эксперимента до инструмента, которым в июле 2025 года пользовались более 22 млн. человек, создавших в общей сложности свыше 168 млн. видео.

Модель хорошо понимает физику движения, естественную мимику персонажей и кинематографическую работу со светом. В конце 2025 года вышло обновление Kling 2.6, с которым модель впервые на рынке предложила комплексную генерацию видео и звука в одном процессе. Она не склеивает картинку и аудио отдельно, а создает синхронизированные диалоги, звуковые эффекты, музыку и фоновую атмосферу из текстового промпта с сохранением контекста сцены.

Генерация видео из текста и фото — основа функционала Kling AI. Модель превращает текстовое описание в видео длиной до 30 секунд в 4K-качестве с плавным движением и профессиональным светом. Kling понимает сложные промпты с указанием движения камеры и стиля. Также нейросеть умеет «оживлять» загруженные фотографии. Например, добавляет портретам естественную мимику, а пейзажам — динамику. Особенно полезен этот инструмент для электронной коммерции, когда нужно показать товар в движении без реальной съемки.

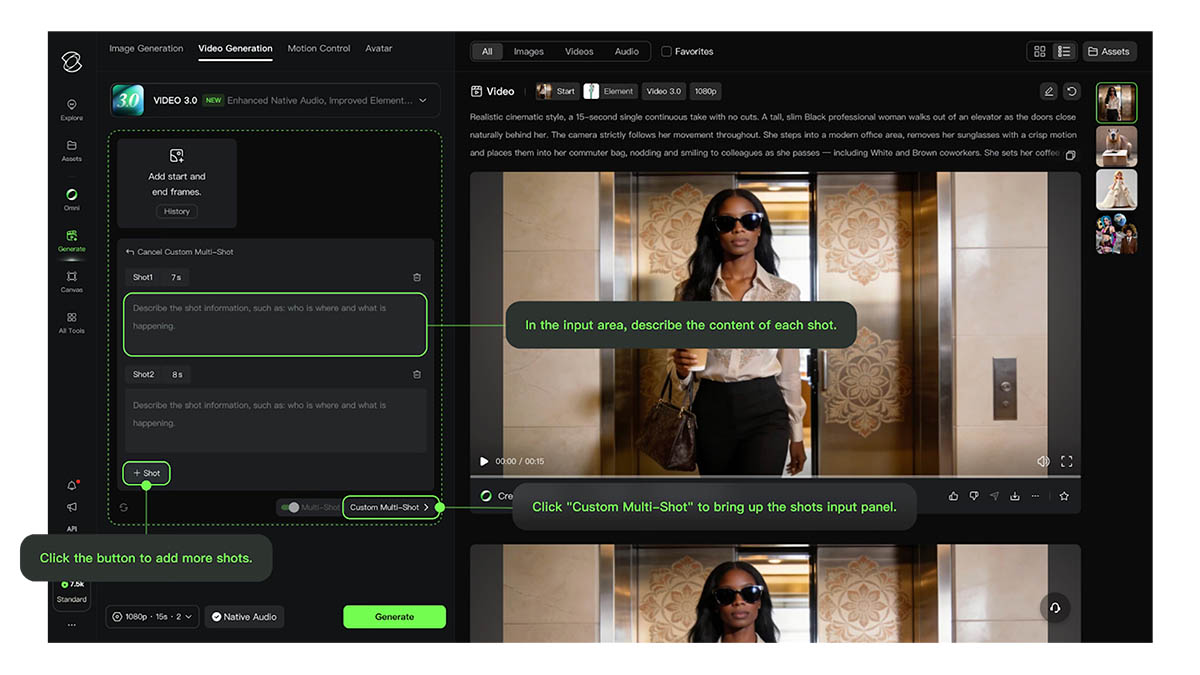

В версии Kling 2.6 стала доступна интеграция звука в процесс генерации. Теперь модель сразу добавляет к изображению фоновую музыку, звуковые эффекты и диалоги с автоматической синхронизацией движения губ. В Kling есть несколько инструментов для решения профессиональных задач: Elements (позволяет загрузить до четырех референсных изображений, например, персонажа, товар, фон, и собрать их в одной сцене), Motion Control (можно «перенести» движение из видео на другого персонажа), Transformation (быстрая замена фона, стиля или самого персонажа в уже готовом видео), Негативный промпт (возможность указать, чего не должно быть в кадре). В начале 2026 года была представлена версия Kling 3.0.

Runway утверждает, что ее модель Gen-4.5 выводит реалистичность генерируемых ИИ видео на качественно новый уровень. Внимание уделяется не только точности визуального отображения пейзажей, людей, животных и объектов, но и тщательной проработке физики движущихся объектов. Даже поведение жидкостей реализовано настолько реалистично, что неискушённому зрителю сложно догадаться, что видео было сгенерировано искусственным интеллектом.

Тем не менее, есть и некоторые недостатки в ее работе. В основном они связаны с логикой взаимодействия объектов на видео. Например, дверь может открываться до того, как кто-то в кадре взялся за ее ручку. Те не менее, новый генератор Runway Gen 4.5 превзошел главных конкурентов в лице Google Veo 3 и OpenAI Sora 2 Pro и возглавил рейтинг ИИ-моделей для генерации видео по текстовым описаниям Video Arena от Artificial Analysis. Создатели Runway утверждают, что новая модель лучше адаптирует генерируемое видео под стилистические запросы в описании и может добиваться более зрелищных визуальных эффектов, которые практически неотличимы от реальных видеосъемок.

Veo 3 от Google — это продвинутый генератор видеороликов с озвучкой по текстовому описанию. Разработка является частью инструмента Flow, объединяющего в себе также Imagen и Gemini — технологии для создателей контента. Veo 3 создает видеоролики, как говорят в Google, согласно ингредиентам (данным промптов), состоящих из текста или набора изображений.

Преимуществом Flow является то, что пользователь может полностью контролировать процесс генерации сцен. Например, доступна регулировка положения камеры, упорядочивание сцен по своему усмотрению, дополнение их новыми кадрами при необходимости прямо на лету. Немаловажным является и качество — доступна генерация видео в разрешении до 4К включительно. Но самое главное преимущество Veo 3 — создание подходящего нативного аудиосопровождения: речи, окружающих звуков, музыки, звуков предметов с учетом материалов, из которых они изготовлены.

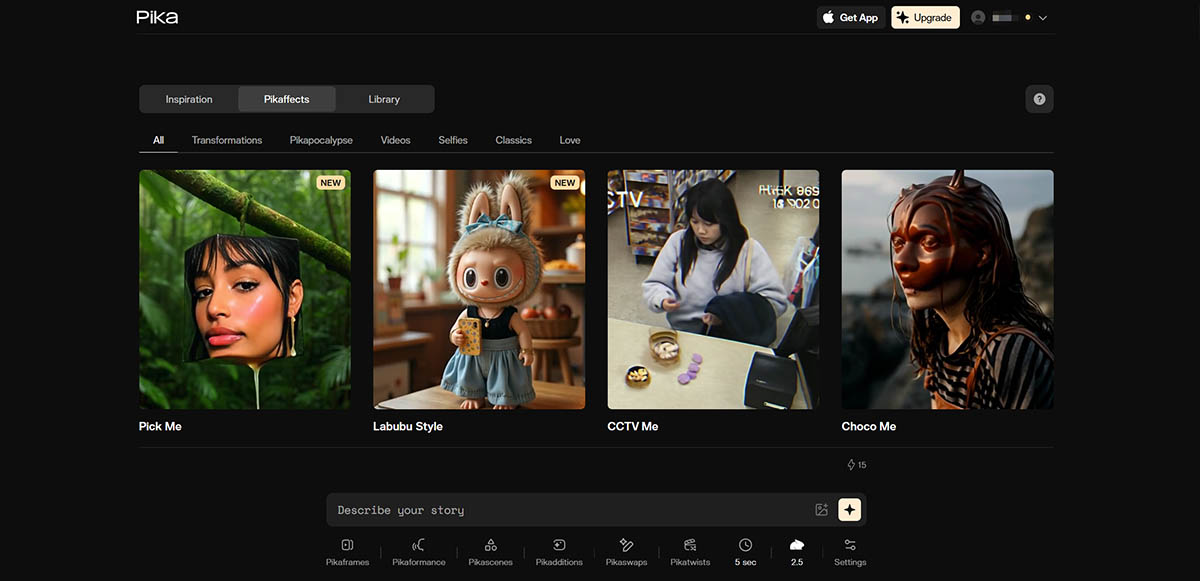

Pika — нейросеть для генерации видео, которая делает упор на визуальные эффекты. Изначально она завирусилась в социальных сетях благодаря ИИ-фильтрам, которые трансформируют изображения. Например, сдувают объекты как воздушный шар или разрезают их как торт. Нейросеть предлагает несколько режимов работы:

- генерация по текстовому запросу и по картинке или одновременно по обоим. Для этого не нужно ничего выбирать, просто загрузите картинку и пропишите запрос;

- Pikaffect — визуальные эффекты для анимации изображений по шаблону. К готовым роликам добавляется звук. Доступно множество вариантов, включая физические вроде «порвать» или «сплющить», а также трендовые, например, превращение в Лабубу или съемка с камеры наблюдения;

- PikaFrames — создает плавные переходы между разными кадрами. Доступно только по подписке;

- PikaScenes — создает консистентные сцены с одинаковыми персонажами и обстановками. Недоступно в бесплатном тарифе;

- PikaAdditions — добавляет в сгенерированный ролик новые объекты. Для этого нужно загрузить картинку;

- PikaSwaps — заменяет любой объект на видео другим. Можно, например, заменить одежду человеку в ролике на другую, задав описание или загрузив фото;

- PikaTwists — добавляет неожиданные повороты в уже сгенерированное видео, чтобы разнообразить сюжет и сделать ролик более интересным и оригинальным.

Проще всего использовать Pikaffect. Достаточно загрузить картинку, выбрать понравившийся фильтр, нажать кнопку генерации, дождаться обработки и сохранить видео. Никаких настроек тут нет. А если не понравился результат, то ролик можно перегенерировать, нажав на Retry. Заготовленные сервисом эффекты работают отлично, но только если выбирать картинку с персонажем, который занимает большую часть изображения. Маленькие объекты он просто не распознает и прикрепляет эффект к пустому пространству.

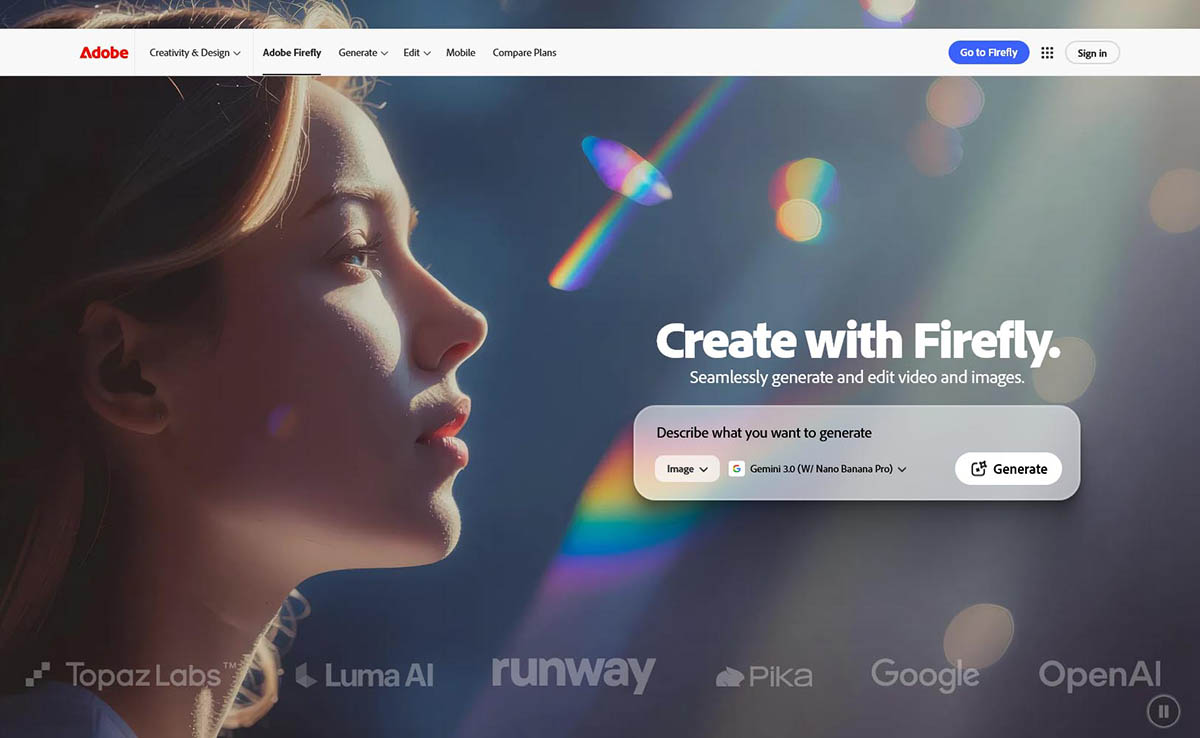

В декабре прошлого года Adobe включила в свою платформу Firefly эксклюзивный доступ к новейшей модели искусственного интеллекта Runway Gen-4.5 для создания видео. Апгрейд превратил инструменты для генерации изображений и видео в нечто гораздо большее — шлюз к самым популярным большим языковым моделям индустрии ИИ для изображений и видео. Концепция проста: подпишитесь на Firefly, и вам не понадобятся отдельные подписки для доступа к ИИ-моделям от других поставщиков.

Компании Adobe и Runway также анонсировали совместную разработку специализированных возможностей ИИ для видео, ориентированных на конкретные потребности профессиональных видеопотоков. Эти инструменты будут доступны эксклюзивно в приложениях Adobe, включая Firefly. Решение должно привлечь высококлассных создателей видео — от Голливуда до YouTube, от брендов и маркетологов до коммерческих и промышленных видеопроизводителей. Сейчас в Firefly доступно около 30 внутренних и внешних больших языковых моделей для изображений и видео. Среди сторонних поставщиков — инструменты Google Gemini и Veo с различными вариантами нового инструмента Nano Banana, ChatGPT и Sora2 от OpenAI, Ray2 и Ray3 от Luma AI, а также предыдущая версия Gen-4 от Runway.

Важная часть маркетинговой кампании Adobe по продвижению своих моделей ИИ заключается в том, что они удобны как для создателей контента, так и для предприятий. Под этим Adobe подразумевает, что модели были обучены на законно полученных наборах данных и «безопасны для бизнеса» с точки зрения авторского права. Это также означает, что модели не воруют у художников. Подписчики Adobe Creative Cloud получают определенное количество кредитов ИИ, включенных в их тарифный план, которые я использовал для создания этих видеороликов с использованием ИИ.

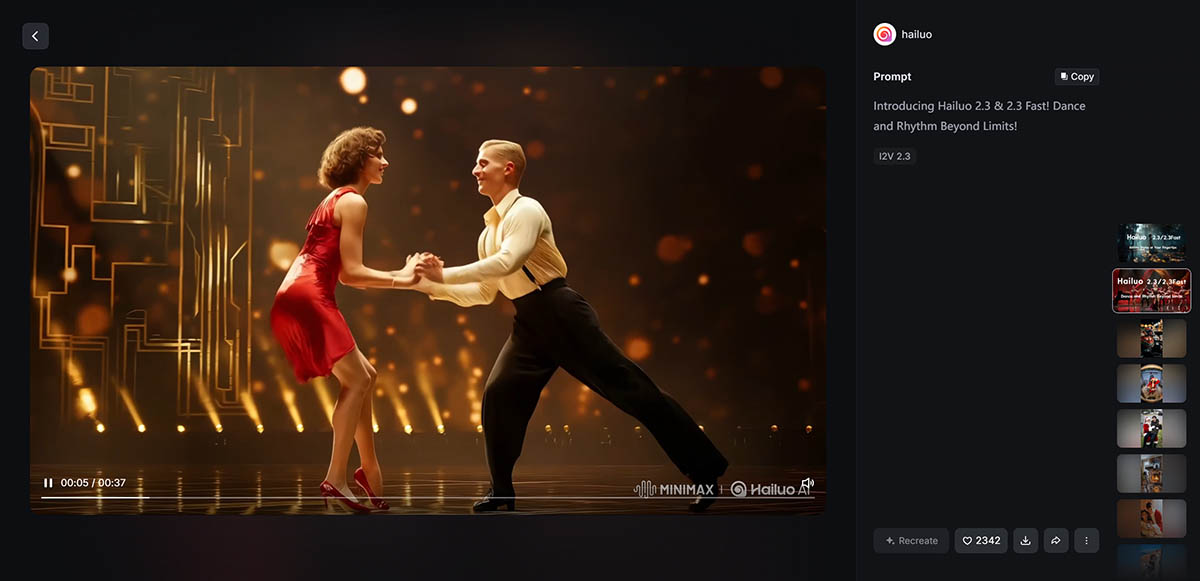

В октябре прошлого года компания Minimax выпустила обновленную линейку своих видеомоделей — Hailuo 2.3 и Hailuo 2.3 Fast. Это свежая версия популярной системы для генерации видео по текстовому описанию, которая делает ролики максимально приближенными к реальной съемке. Главный акцент разработчиков — на физической правдоподобности и естественности движений. Hailuo 2.3 предлагает:

- Плавные движения — персонажи теперь двигаются реалистично, без «дерганых» кадров и склеек;

- Живые эмоции — мимика и выражения лиц выглядят естественно даже в длинных сценах;

- Физическая точность — улучшены свет, отражения, взаимодействие объектов;

- Длинные ролики без потери качества — модель стабильно держит стиль и цвет от начала до конца;

- Более корректная анимация одежды, теней и рук — одно из самых сложных направлений в видео-ИИ.

Облегченная версия Hailuo 2.3 Fast оптимизирована для скорости генерации, сохраняя большую часть визуального качества оригинала. По заявлениям разработчиков, новая версия способна создавать короткие видеоклипы в 3-5 раз быстрее, что делает ее идеальной для контент-мейкеров, SMM и тестов идей.

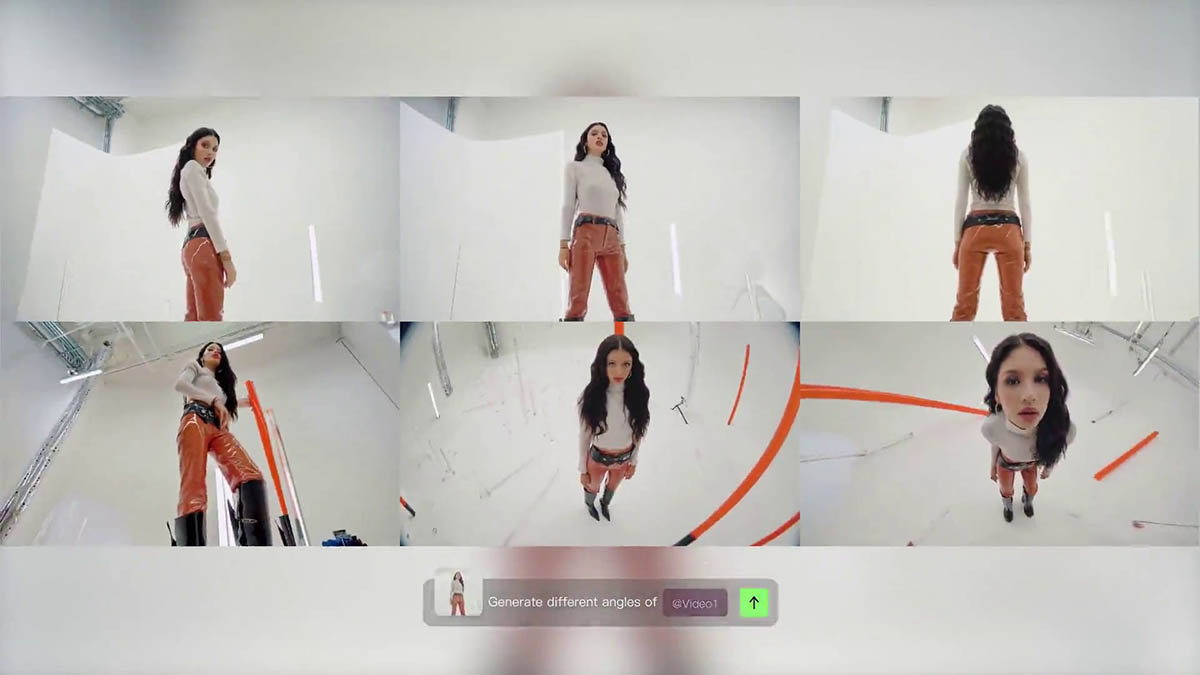

В сентябре прошлого года стартап Luma AI, известный по своему инструменту Dream Machine, выпустил Ray3 — модель, которая выводит генерацию видео на новый уровень. В отличие от предыдущих систем, Ray3 не просто соединяет кадры, а умеет рассуждать. Она анализирует сюжет, учитывает физику объектов и следит за тем, чтобы персонажи, предметы и окружение не менялись случайным образом. Это делает видео более реалистичными и последовательными, чем у конкурентов. Особое внимание привлекает то, что Ray3 стала первой моделью, создающей ролики в 16-битном HDR. Такой формат позволяет добиться более высокой глубины цвета и динамического диапазона, что важно не только для профессиональной видеопродукции, но и для будущих приложений в кино, рекламе и играх.

Генерация поддерживается сразу в нескольких сценариях: по текстовому запросу, по загруженному изображению или по исходному видео. Это открывает пространство для экспериментов — от быстрых визуальных идей до полноценного сторибординга. Пробовать Ray3 можно на всех тарифах, но в бесплатной версии есть ограничения по качеству итогового материала. Тем не менее, даже базовый доступ позволяет ощутить разницу. Видео выглядят цельнее, а разговорный стиль модели дает шанс на появление настоящих короткометражек, собранных ИИ без вмешательства человека. Для индустрии генеративного видео это событие можно считать знаковым. Ray3 делает шаг к системам, которые не просто рисуют красивые картинки, а начинают понимать саму логику истории и физику мира.

Vidu Q2 «Reference-to-Video» обеспечивает значительный скачок в реализме, передавая тонкие эмоции, такие как нерешительная улыбка, любопытный взгляд или напряженное ожидание, с естественной плавностью. Движения кажутся плавными и живыми, заменяя жесткие, роботизированные движения яркой энергией. Платформа также обрабатывает кинематографические приемы, такие как плавные переходы камеры, панорамирование и глубина резкости, имитируя профессиональную киносъемку. Сцены плавно переходят от общих планов к крупным, позволяя создателям создавать истории, обладающие как величием, так и эмоциональной глубиной.

Новая версия лучше понимает подсказки, более точно передавая желаемое настроение и смысл. Это позволяет создателям сосредоточиться на повествовании, а не на исправлении ошибок, превращая генеративное видео в практичный повседневный инструмент. Благодаря более быстрой генерации и более высокой точности создатели могут создавать более длинные, выразительные видеоролики для фильмов, анимации, рекламы и коммерческого контента с минимальными корректировками.

Также следует отметить, что в начале этого года компания ShengShu Technology представила значительные обновления своей платформы для создания видеоконтента. Vidu Q3 обеспечивает вывод до 16 секунд нативного HD-видео с многоязычной озвучкой, точной синхронизацией губ, кинематографическим управлением и плавными переходами, а Vidu Q2 «Reference-to-Video» Pro позволяет создать первую в мире модель «любой объект в качестве эталона», поддерживающую множество видео- и графических эталонов для итеративного редактирования без полной перегенерации.

Seedance 1.0 Pro — видеогенеративная модель от ByteDance, компании, стоящей за TikTok. Это усовершенствованная версия Seedance, ориентированная на создание реалистичных и синематографичных видеороликов по текстовому описанию. Модель привлекла внимание сообщества благодаря качеству, которое сопоставимо или даже превосходит результаты таких флагманов, как Sora от OpenAI. В числе ключевых особенностей:

- Разрешение и длина видео: модель способна создавать видео длительностью до 16 секунд в разрешении 1080p;

- Физическая правдоподобность: Seedance 1.0 Pro учитывает инерцию, гравитацию и кинематографичность движения объектов;

- Реалистичные лица и мимика: персонажи в кадре двигаются натурально, с сохранением лицевой идентичности;

- Контроль и консистентность: стабильное следование сценарию и логике сцен;

- Скорость генерации: высокая — на уровне продвинутых решений.

Модель использует 3D aware diffusion с элементами пространственного представления, Dual-stream attention для одновременной работы с текстом и видео, а также ранжирование по качеству с помощью дополнительных моделей оценки. Seedance генерирует видео без промежуточных кадров или начальных сбоев, что говорит о продвинутом механизме предварительной обработки текста и сценариев. Seedance 1.0 Pro — серьезный претендент на лидерство в области генерации видео по тексту. Качество, длительность, физика и стабильность вывели модель в один ряд с Sora и даже дали повод говорить о преимуществах.