Компания Microsoft представила новую функцию Content Safety в облачной инфраструктуре Azure, которая предназначена для обнаружения уязвимостей, поиска «галлюцинаций» у ИИ-систем, а также блокировки недопустимых запросов от пользователей.

Content Safety сканирует ответы ИИ-моделей и выявляет в них неточности, сравнивая выходные данные с исходными материалами клиента и даже исправляет ошибки. По словам Нумото Такеши, исполнительного вице-президента компании Microsoft , это поможет обеспечить большую безопасность, конфиденциальность и защиту ИИ-систем.

«Мы все нуждаемся в ИИ, которому можно доверять», — отметил Такеши.

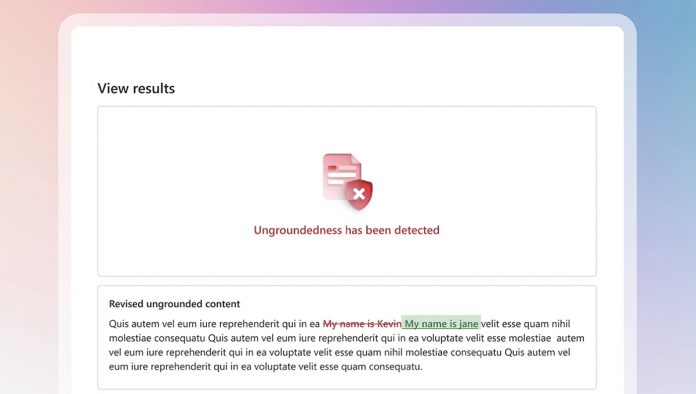

Обнаружив ошибку, система выделяет ее, сопровождает сведениями, почему предоставленная информация неверна, и переписывает проблемный контент. Все действия происходит еще «до того, как пользователь сможет увидеть» неточность.

Абсолютной гарантии надежности функция не дает. Content Safety осуществляет согласование ответов с базовыми документами при помощи больших и малых языковых моделей, но и она не застрахована от ошибок. «Важно отметить, что обнаружение ошибок при помощи функции не решает проблему «точности», но помогает согласовывать ответы генеративного ИИ с базовыми документами», — пояснил Такеши.

Content Safety уже доступна в предварительной версии в пакете Azure AI Studio.