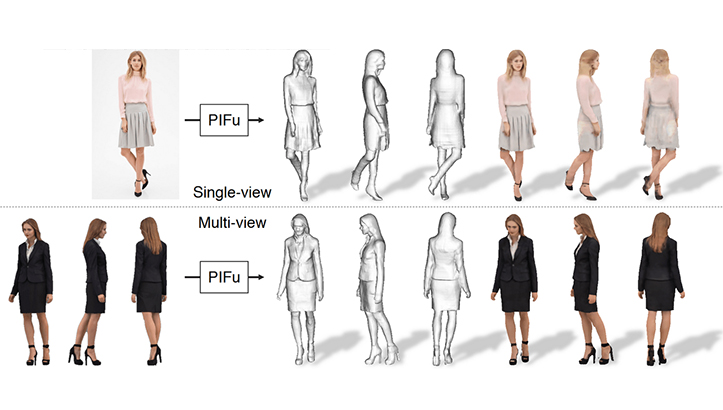

Американские и японские разработчики научили нейросеть создавать цветную 3D-модель человека по одной или нескольким фотографиям. Особенность алгоритма заключается в том, что он достаточно точно воссоздает изображение человека со спины, которое не видно на исходном снимке, отмечают авторы статьи, которая будет представлена на конференции ICCV 2019.

Сложность воссоздания объемного образа предмета и человека по фотографии заключается в том, что на начальном этапе существуют данные только с одного ракурса. Существующие алгоритмы способны создать либо неточную модель с сохранением цвета снимка, либо точную с потерей цвета.

Решение, получившее название PIFu (Pixel-aligned Implicit Function), состоит из двух последовательных сверточных нейросетей, одна из которых анализирует исходный снимок (либо несколько исходных снимков), обнаруживает на нем тело человека и используя методику под названием «Шагающие кубики», воссоздает по нему 3D-модель, а вторая придает получившейся модели цветовые оттенки и фон.

Нейросеть обучалась на датасете из 491 модели, созданной на основе базы RenderPeople — это набор высококачественных 3D-моделей людей, полученных с помощью фотограмметрических сканеров.

На опубликованном авторами ролике можно видеть, что алгоритм достаточно качественно воссоздает всю модель, в том числе и со спины. Кроме того, в ролике продемонстрировано, что даже наличие трех кадров вместо одного значительно повышает качество итоговой модели. Авторы показали, что во многих аспектах алгоритм справляется с воссозданием 3D-модели лучше, чем аналогичные алгоритмы других разработчиков.

По словам исследователей, их разработка — это еще один шаг на пути к созданию методики, позволяющей извлекать 3D-сцены из обычных видео.