Amazon, AMD и целый ряд стартапов все активнее предлагают альтернативы ускорителям искусственного интеллекта NVIDIA. Актуальные ускорители NVIDIA стоят до 15000 долларов, а цены на Blackwell и вовсе исчисляются несколькими десятками тысяч. Тем временем поднимаются стартапы, которым удалось привлечь инвестиции. SambaNova Systems, Groq и Cerebras Systems уверяют, что при запуске искусственного интеллекта им удалось добиться преимущества как в производительности, так и в цене. Но рост конкуренции пока не означает, что NVIDIA в ближайшее время утратит лидерство.

Ведущие производители ИИ-чипов

1. NVIDIA

NVIDIA разрабатывает графические процессоры (GPU) для геймеров с 90-х годов прошлого века. Это — производитель чипов без собственных производственных мощностей, который передает большую часть производства чипов на аутсорсинг TSMC. В числе основных направлений деятельности компании:

Настольные решения для ИИ

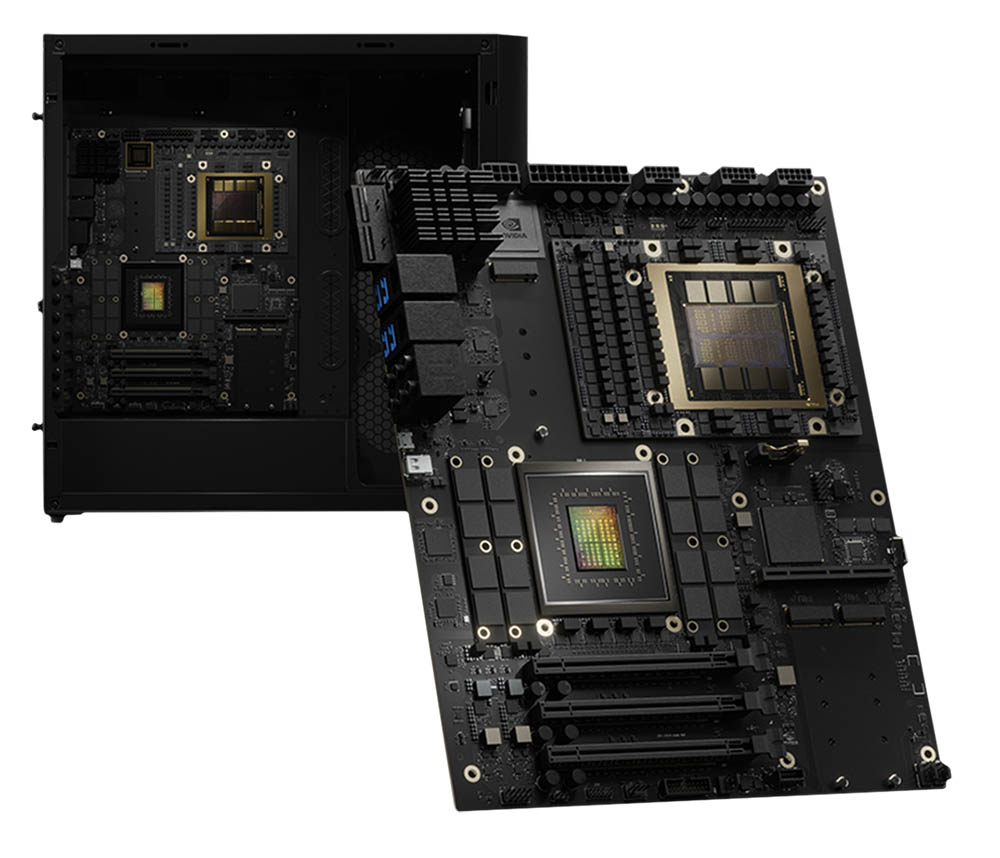

DGX Spark (ранее Project Digits) — это суперкомпьютер с ИИ, выполненный в форм-факторе настольного PC, предназначенный для ИИ-инженеров и специалистов по данным, который стоит около 3000 долларов. Он примерно такого же размера, как Mac mini, и работает на базе NVIDIA GB10 Grace Blackwell Superchip с объемом памяти 128 Gb. Устройство способно обрабатывать вывод LLM и осуществлять тонкую настройку для моделей с 200 миллиардами параметров, используя NVLink-C2C для высокоскоростной связи CPU+GPU.

Решения для центров обработки данных

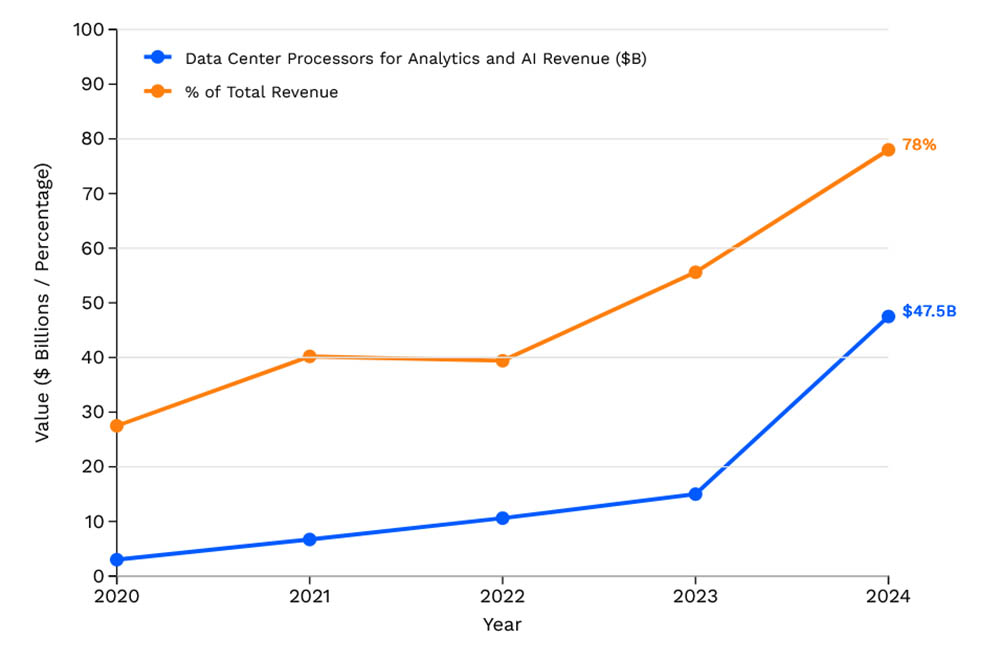

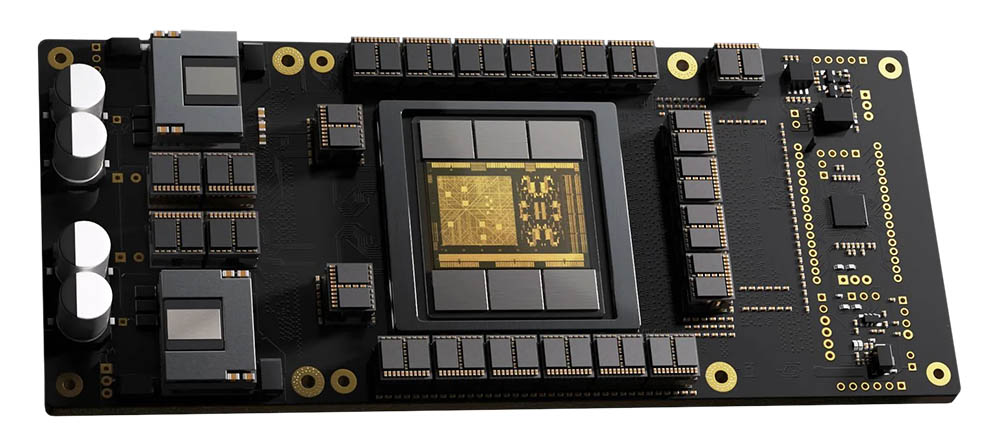

Компания производит ИИ-чипы в соответствии со своими архитектурами Ampere, Hopper и совсем новой Blackwell. Благодаря буму генеративного ИИ NVIDIA добилась отличных результатов за последние годы, достигнув триллиона долларов в оценке и укрепив свой статус лидера на рынках аппаратного обеспечения GPU и ИИ. На диаграмме показано, как вырос доход NVIDIA в этом сегменте за эти годы и стал основным источником прибыли компании.

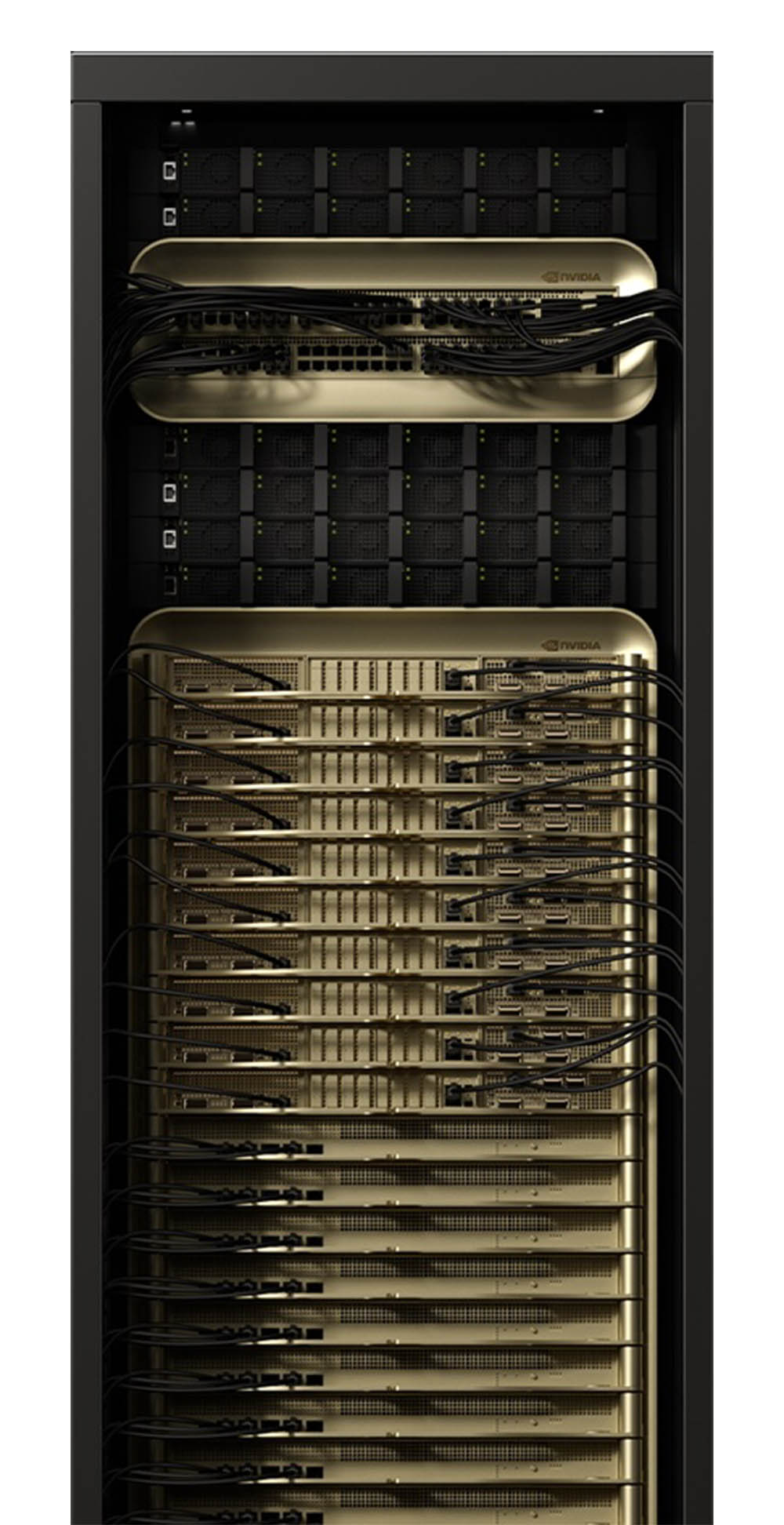

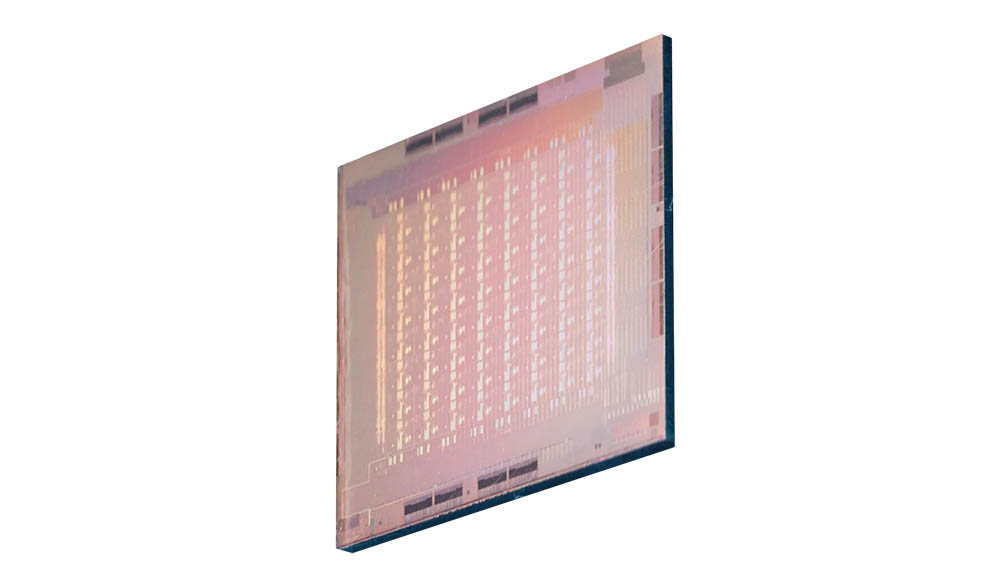

Чипсеты NVIDIA предназначены для решения бизнес-задач в различных отраслях. DGX A100 и H100 стали успешными флагманскими ИИ-чипами от NVIDIA, разработанными для обучения ИИ и вывода в центрах обработки данных. NVIDIA продолжила работу в этом направлении, представив чипы H200, B300 и GB300; серверы HGX, такие как HGX H200 и HGX B300, которые объединяют 8 из этих чипов; серию NVL и GB200 SuperPod, которые объединяют еще больше чипов в большие кластеры.

Облачные GPU

Благодаря силе своего предложения для центров обработки данных NVIDIA практически является монополистом на рынке облачного ИИ, поскольку большинство игроков предлагает только графические процессоры NVIDIA в качестве облачных графических процессоров. NVIDIA также запустила свое облачное предложение DGX, предоставляющее инфраструктуру облачных графических процессоров напрямую предприятиям, минуя поставщиков облачных услуг.

GPU для графики

Xbox использует чипсет, разработанный совместно NVIDIA и Microsoft. Графические процессоры NVIDIA для розничных пользователей включают серию GeForce.

Последние разработки

- DGX Cloud Lepton

Анонсированный 19 мая 2025 года на Computex, DGX Cloud Lepton от NVIDIA — это торговая площадка, соединяющая разработчиков ИИ с поставщиками облачных вычислений GPU NVIDIA, такими как CoreWeave, Lambda и Crusoe. Она обеспечивает гибкий доступ к ресурсам GPU для обучения и вывода моделей ИИ, минуя зависимость от традиционных поставщиков облачных вычислений. Это укрепляет корпоративную облачную стратегию NVIDIA.

- NVIDIA Dynamo

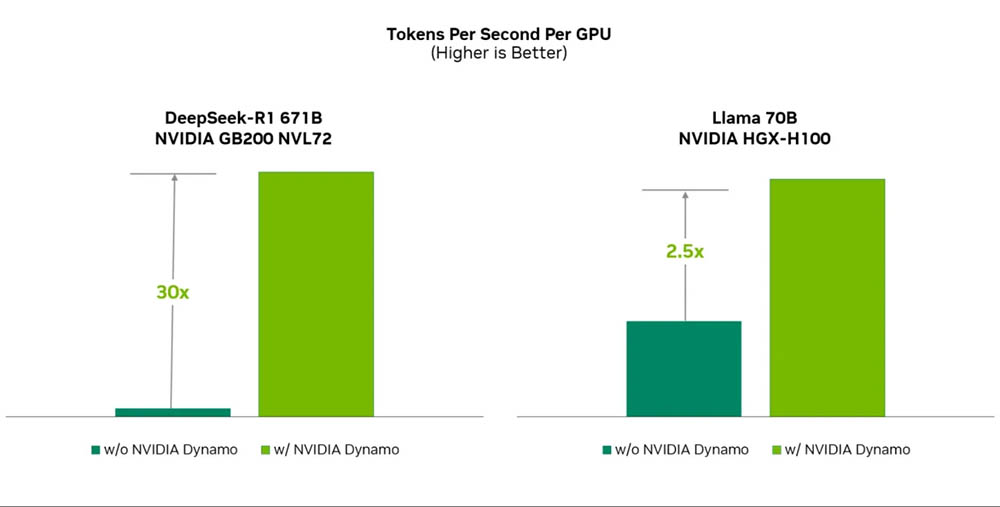

NVIDIA Dynamo, анонсированная на GTC 2025, — это новая среда вывода с открытым исходным кодом, предназначенная для высокопроизводительного развертывания генеративных моделей ИИ с малой задержкой в распределенных средах, что позволяет увеличить обслуживание запросов до 30 раз на NVIDIA Blackwell, как показано на рисунке ниже. Эта структура, совместимая с такими популярными инструментами, как PyTorch и TensorRT-LLM, использует такие инновации, как дезагрегированные этапы вывода и динамическое планирование GPU для оптимизации производительности и снижения затрат. Доступная на GitHub для разработчиков и включенная в микросервисы NVIDIA NIM для корпоративных решений, Dynamo обеспечивает масштабируемое и экономичное обслуживание генеративного ИИ от систем с одним или несколькими GPU.

- DeepSeek

Выпуск DeepSeek-R1 показал, что современные модели можно обучать с помощью относительно небольшого количества графических процессоров. Это привело к снижению стоимости акций NVIDIA. Но это может быть позитивным для NVIDIA, поскольку чем больше вычислительной мощности обеспечивает утилита, тем шире ее следует использовать. Однако, учитывая, что производительность систем GPU ежегодно повышается в несколько раз благодаря улучшениям в конструкции чипов и межсоединениях, покупателям было бы разумно не покупать больше, чем требуется в год, поскольку это может привести к владению устаревшими системами.

Тарифы и экспортные ограничения

NVIDIA обязана продавать менее мощные версии своих чипов в Китае из-за экспортных ограничений, и это побудило китайское правительство и индустрию чипов разрабатывать конкурентоспособные чипы локально. Хотя китайские чипы уступают последним чипам NVIDIA, они набирают обороты и могут представлять угрозу доминированию NVIDIA на рынке в будущем.

Конкуренция на рынке вывода

В то время как NVIDIA доминирует на рынке «обучения» ИИ, конкуренция накаляется в «выводе», а именно в развертывании моделей ИИ для задач реального мира. Такие компании, как AMD, и многочисленные стартапы, включая Untether AI и Groq, разрабатывают чипы, которые стремятся предоставить более экономичные решения для вывода, особенно фокусируясь на снижении энергопотребления. Новые «рассуждающие» модели ИИ требуют большей вычислительной мощности, поэтому в NVIDIA считают, что использование таких моделей будет поддерживать ее архитектуру в долгосрочной перспективе, и ожидает, что рынок вывода в конечном итоге превзойдет рынок обучения по размеру, даже если его доля на рынке будет меньше.

2. AMD

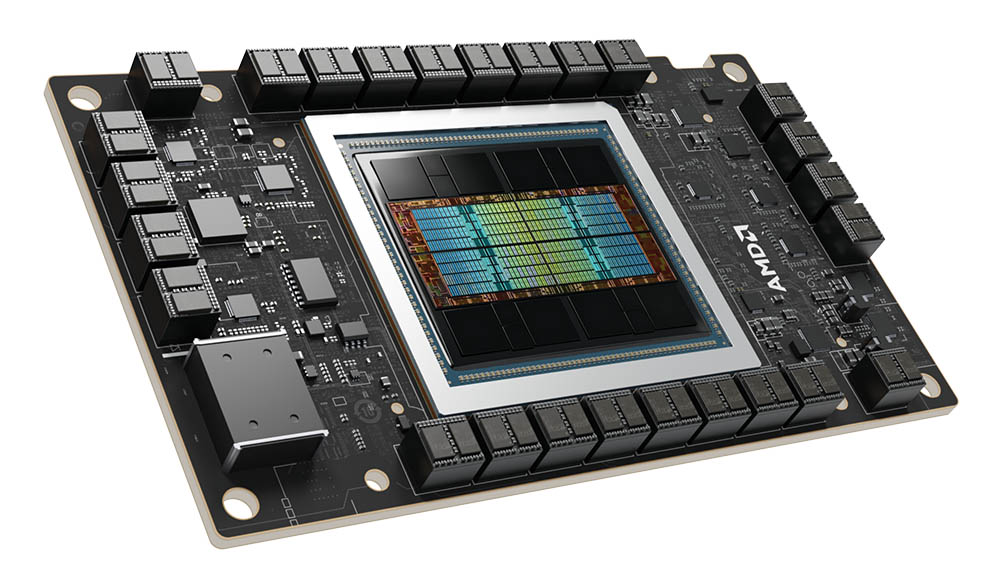

AMD — производитель чипов без собственных производственных мощностей, предлагающий на рынке центральные процессоры, графические процессоры и ускорители ИИ. AMD запустила MI300 для рабочих нагрузок обучения ИИ в июне 2023 года и конкурирует с NVIDIA за долю рынка. Есть стартапы, исследовательские институты, предприятия и технологические гиганты, которые перешли на оборудование AMD в 2023 году, поскольку оборудование NVIDIA для ИИ было трудно закупить из-за быстрорастущего спроса на генеративный ИИ, что было вызвано запуском ChatGPT. AMD выпустит серию MI350, чтобы заменить MI300 и конкурировать с H200 от NVIDIA. В AMD утверждают, что MI325X — еще один недавно выпущенный чип — имеет лидирующую на рынке производительность вывода. AMD также сотрудничает с компаниями, занимающимися машинным обучением, такими как Hugging Face, чтобы позволить специалистам по данным более эффективно использовать свое оборудование.

Экосистема программного обеспечения имеет решающее значение, поскольку производительность оборудования во многом зависит от его оптимизации. Например, у AMD и NVIDIA были публичные разногласия по поводу бенчмаркинга H100 и MI300. В центре разногласий были пакет и плавающая точка для использования в бенчмарке. Согласно последним бенчмаркам, MI300 лучше или на одном уровне с H100 для вывода на 70B LLM.

Программное обеспечение

Хотя оборудование AMD догоняет NVIDIA, его программное обеспечение отстает с точки зрения удобства использования. В то время, как CUDA работает из коробки для большинства задач, программное обеспечение AMD требует значительной настройки.

Экосистема

Как и NVIDIA, AMD выборочно инвестирует в пользователей своих решений, чтобы стимулировать принятие своего оборудования.

3. Intel

Intel является крупнейшим игроком на рынке CPU и имеет долгую историю разработки полупроводников. В отличие от NVIDIA и AMD, Intel использует собственные производственные мощности для создания своих чипов. Gaudi3 — это новейший процессор-ускоритель ИИ от Intel. Однако прогноз Intel по продажам Gaudi3 на 2024 год составлял около 500 млн. долларов, что значительно ниже миллиардов, которые AMD прогнозировала заработать в 2024 году. Intel испытывает проблемы с управлением, о чем свидетельствует уход ее генерального директора Пэта Гелсингера в декабре 2024 года. Значительная часть членов совета директоров Intel не имеет опыта управления полупроводниковой компанией в оперативном режиме. После ухода генерального директора стратегия Intel на рынках ИИ пока не ясна.

Провайдеры публичных облаков тоже производят ИИ-чипы

4. AWS

AWS производит чипы Trainium для обучения моделей ИИ и чипы Inferentia для вывода. Хотя AWS является лидером рынка публичных облаков, компания начала создавать собственные чипы сразу же после Google. Сотни тысяч чипов Trainium2 используются для формирования кластера Project Rainier, который поддерживает модели разработчика LLM Anthropic.

5. Google Cloud Platform

Google Cloud TPU — это специально созданный чип ускорителя машинного обучения, который поддерживает такие продукты Google, как Translate, Photos, Search, Assistant и Gmail. Его также можно использовать через Google Cloud. Google анонсировала TPU в 2016 году. Последний Trillium TPU — это шестое поколение. Также Google представила Ironwood. Это последнее поколение ИИ-чипов, которое специально разработано для сложных «моделей мышления», таких как LLM и MoE, предлагая массивную параллельную обработку (4614 терафлопс на чип) и масштабирование до 42,5 экзафлопс в 9216-чиповых модулях. Ironwood обеспечивает значительные преимущества по сравнению с Trillium, включая в 2 раза большую энергоэффективность, в 6 раз большую емкость памяти с высокой пропускной способностью (192 Gb на чип), в 4,5 раза большую пропускную способность HBM (7,2 Tb на чип) и в 1,5 раза большую скорость межчипового соединения (1,2 Тбит/с). Он также оснащен улучшенным SparseCore для больших встраиваемых систем. Google также выпускает гораздо меньший Edge TPU для различных нужд, предназначенный для развертывания на периферийных устройствах, таких как смартфоны и оборудование IoT.

6. Alibaba

Alibaba выпускает чипы, такие как Hanguang 800, для вывода. Однако некоторые североамериканские, европейские и австралийские организации (например, в оборонной промышленности) могут не захотеть использовать Alibaba Cloud по геополитическим причинам.

7. IBM

В 2022 году IBM анонсировала свой новейший чип глубокого обучения — блок искусственного интеллекта (AIU). В компании рассматривают возможность использования этих чипов для своей платформы генеративного ИИ watson.x. AIU построен на процессоре IBM Telum, который обеспечивает возможности обработки ИИ на системах IBM Z. На момент запуска основные варианты использования процессоров Telum включали обнаружение мошенничества. IBM также продемонстрировала, что объединение вычислений и памяти может привести к повышению эффективности. Это было продемонстрировано в прототипе процессора NorthPole.

8. Huawei

HiSilicon Ascend 910C от Huawei является частью семейства чипов Ascend 910, представленного в 2019 году. Из-за санкций лаборатории ИИ в Китае не могут покупать новейшие чипы с самой высокой производительностью у американских компаний, таких как NVIDIA или AMD, поэтому они экспериментируют с Ascend 910C. Облако Huawei размещает модели DeepSeek, и исследователи из DeepSeek утверждает, что оно может достичь 60% производительности вывода NVIDIA H100. А недавно США порекомендовали компаниям по всему миру отказаться от использования процессоров Ascend, поскольку они почти наверняка содержат американские технологии или были изготовлены с их использованием.

Собственные чипы производят и провайдеры облачного ИИ

У этих провайдеров нет публичных облаков с комплексными возможностями, такими как гиперскейлеры. Они предоставляют ограниченные облачные сервисы, как правило, ориентированные на вывод ИИ.

8. Groq

Groq был основан бывшими сотрудниками Google. Компания представляет LPU — новую модель архитектуры чипов ИИ, которая призвана упростить компаниям внедрение своих систем. Стартап уже привлек около 350 млн. долларов и выпустил свои первые модели чипов, такие как процессор GroqChip, ускоритель GroqCard и т.д. Компания сосредоточена на выводе LLM и выпустила контрольные показатели для Llama-2 70B.

Недавно Groq получила значительное инвестиционное обязательство в размере 1,5 млрд. долларов от Саудовской Аравии для расширения поставок своих передовых чипов ИИ в страну. Эти инвестиции будут использованы для расширения существующего центра обработки данных Groq в Даммаме (Саудовская Аравия), построенного в партнерстве с Aramco Digital. В I квартале 2024 года компания сообщила, что 70 тысяч разработчиков зарегистрировались на ее облачной платформе и создали 19 тысяч новых приложений.

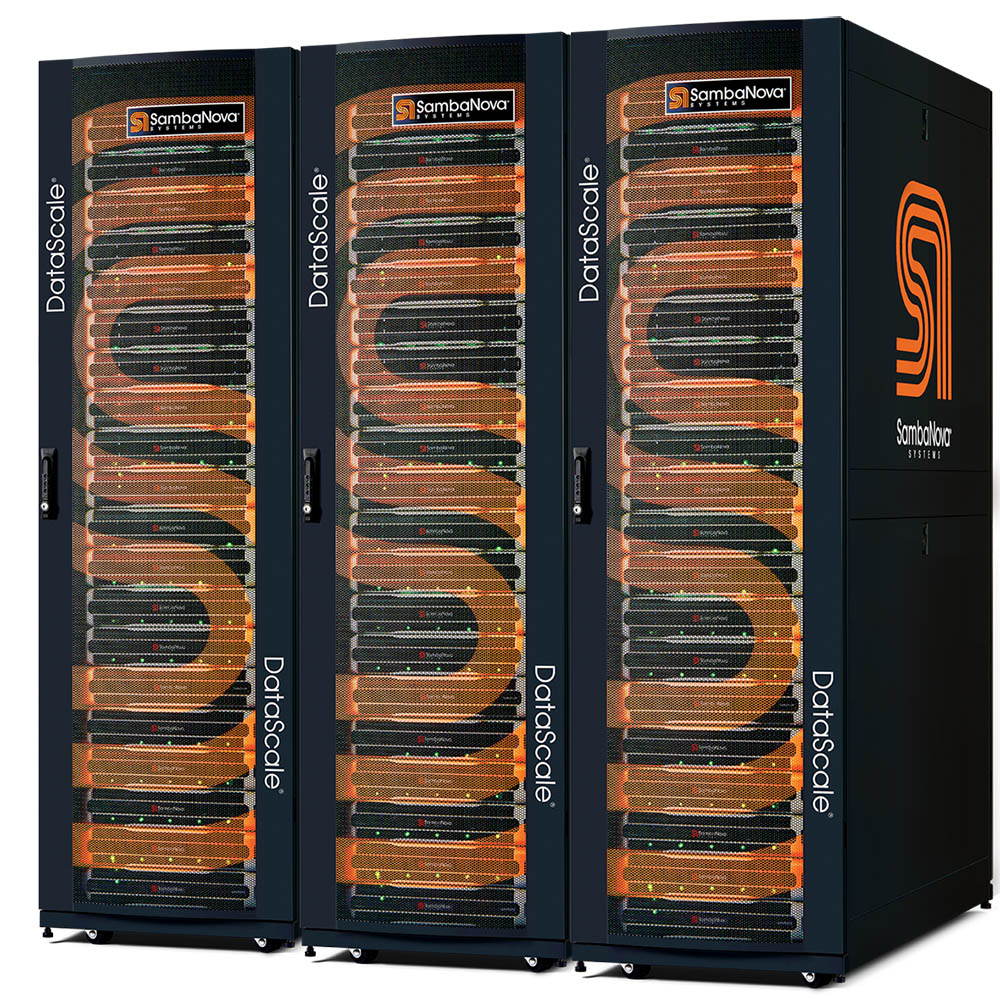

9. SambaNova Systems

SambaNova Systems была основана в 2017 году с целью разработки высокопроизводительных, высокоточных аппаратно-программных систем для больших объемов генеративных рабочих нагрузок ИИ. Компания разработала чип SN40L и привлекла более 1,1 млрд. долларов финансирования. Важно отметить, что SambaNova Systems также сдает свою платформу в аренду предприятиям. Подход SambaNova Systems к платформе ИИ как к услуге упрощает внедрение их систем и поощряет повторное использование оборудования.

Ведущие стартапы в области производства ИИ-чипов

Следует также представить несколько стартапов, специализирующихся на производстве ИИ-чипов, названия которых мы, возможно, будем слышать чаще в ближайшем будущем. Несмотря на то, что эти компании были основаны совсем недавно, они уже привлекли миллионы долларов.

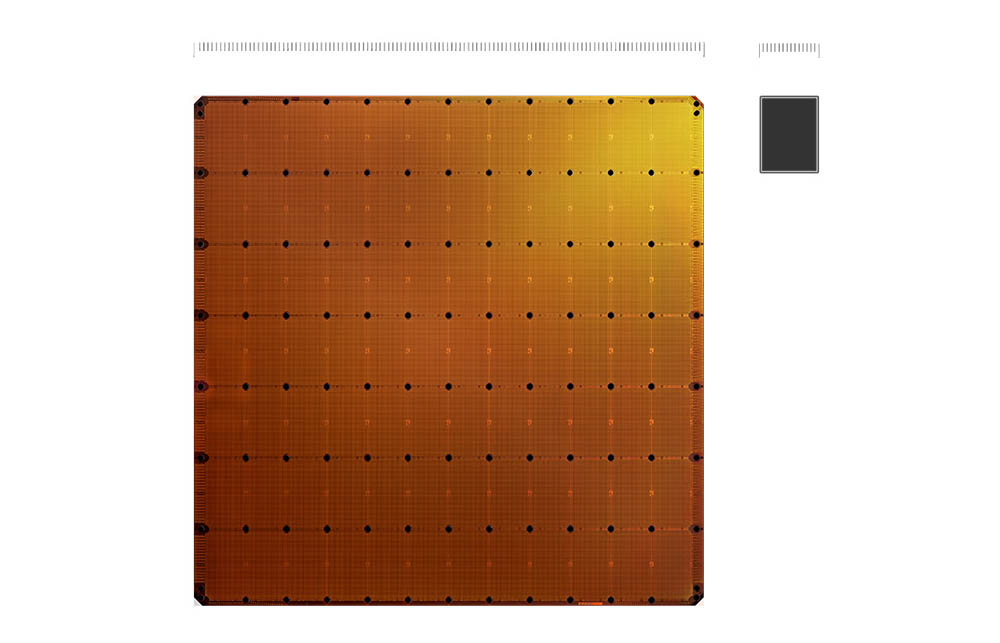

10. Cerebras

Стартап Cerebras был основан в 2015 году. В августе 2024 года стартап представил технологию Cerebras inference — самое быстрое решение для вывода ИИ в мире. Она работает с чипами Wafer Scale Engine третьего поколения, обладающими памятью в 44 Gb на одном чипе, устраняя необходимость в использовании внешней памяти. WSE-3 обеспечивает 21 петабайт/с совокупной пропускной способности памяти, а это в 7000 раз больше, чем у ИИ-ускорителя H100 от NVIDIA. Это пока единственный чип ИИ с вычислительной мощностью и пропускной способностью памяти петабайтного масштаба. Он предназначен для обслуживания моделей с миллиардами и триллионами параметров.

В Cerebras уже помогли Meta поставить рекорд вывода языковой модели семейства Llama с открытым исходным кодом. Llama 3 8B с 8 млрд. параметров обучили и выпустили в открытый доступ всего за несколько часов. Стартап работает с такими фармацевтическими компаниями, как AstraZeneca и GlaxoSmithKline, а также исследовательскими лабораториями, которые используют эти чипы для моделирования. Компания также нацелена на производителей LLM, поскольку ее чипы могут снизить затраты на вывод для пограничных моделей. Cerebras также предлагает свои чипы в собственном облаке для предприятий.

11. d-Matrix

Стартап d-Matrix создал ИИ-ускоритель Corsair, оптимизированный для быстрого пакетного инференса больших языковых моделей. Архитектура ускорителя основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости порядка 150 Тбайт/с. Как отмечают разработчики, новинка отличается производительностью и энергоэффективностью. Среди инвесторов d-Matrix такие компании, как Microsoft, Nautilus Venture Partners, Entrada Ventures и SK hynix.

12. Rebellions

Корейский стартап привлек 124 млн. долларов в 2024 году и сосредоточен на выводе LLM.40. Тогда же Rebellions объединился с другой корейской компанией по проектированию полупроводников SAPEON и стал единорогом. В ассортименте компании чипы Ion и Atom, оптимизированные для ИИ-приложений. Первый был создан по 7-нм техпроцессу TSMC и обеспечивает пиковую производительность FP16 на уровне 4 Тфлопс, а на операциях INT8 и INT4 быстродействие достигает 16 и 32 TOPS соответственно. В свою очередь, изделие Atom, основанное на 5-нм технологии, предназначено для обработки LLM, содержащих до 7 млрд. параметров. Производительность на операциях FP16 достигает 32 Тфлопс, INT8 — 128 TOPS. Кроме того, данное решение включает 16 Gb памяти GDDR6 и использует интерфейс PCIe 5.0.

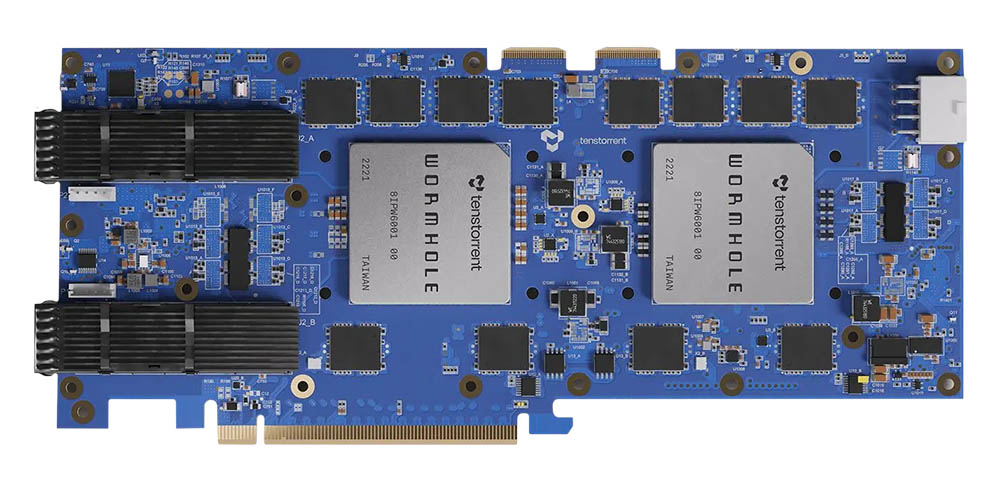

13. Tenstorrent

Стартап Tenstorrent производит чипы Wormhole, настольные компьютеры и серверы на их базе. Компания также предоставляет программный стек для своего решения. Tenstorrent привлек 700 млн. долларов при оценке в более 2,6 млрд. долларов в декабре 2024 года. Одним из инвесторов Tenstorrent является Джефф Безоса.

14. Etched

Стартап Etched, основанный в 2022 году выпускниками Гарварда, в прошлом году анонсировал самый быстрый, по словам самих разработчиков, ИИ-ускоритель Sohu. Секрет высокой производительности заключается в том, что Sohu представляет собой узкоспециализированный 4-нм ASIC, который умеет работать только с моделями-трансформерами. Сообщается, что 8 чипов Sohu могут генерировать более 500 тысяч токенов в секунду, что на порядок больше, чем могут достичь столько же чипов NVIDIA B200.

15. Extropic

Стартап Extropic привлек раунд в размере 14 млн. долларов в конце 2023 года. Компания представила документ Litepaper, в котором изложен подход к ускорению искусственного интеллекта посредством термодинамических вычислений. Кроме того, Extropic объявила о создании прототипа соответствующего процессора, причем этот чип, мало того что изготовлен из алюминия, а не кремния, так еще и обладает сверхпроводимостью. Правда, это означает, что работает он при сверхнизких температурах, поэтому стартап пока работает над чипом, который будет функционировать при комнатной температуре.

О каких производителях оборудования для ИИ мы можем услышать в ближайшем будущем?

Хотя это привлекательные решения для ИИ, в настоящее время существует ограниченное количество показателей их эффективности, поскольку они являются новичками на рынке.

16. Apple

Проект Apple ACDC сосредоточен на создании чипов для вывода ИИ. Apple уже является крупным разработчиком собственных чипов, используемых в iPhone, iPad и Macbook.

17. Meta

Meta Training and Inference Accelerator (MTIA) — это семейство процессоров для рабочих нагрузок ИИ, таких как обучение моделей LLaMa Meta. Последняя модель — Next Gen MTIA, которая основана на 5-нм технологии TSMC, как утверждается, имеет в 3 раза большую производительность по сравнению с MTIA v1. MTIA будет размещаться в стойках, содержащих до 72 ускорителей. MTIA в настоящее время предназначен для внутреннего использования Meta, однако, если компания в будущем запустит корпоративное предложение генеративного ИИ на основе LLaMa, эти чипы могут стать основой такого предложения.

18. Microsoft Azure

На Hot Chips 2024 компания Microsoft представила Maia 100 — свой первый пользовательский ускоритель ИИ, разработанный для оптимизации крупномасштабных рабочих нагрузок ИИ в Azure посредством аппаратной и программной совместной оптимизации. Эта вертикально интегрированная система оснащена пользовательским чипом, созданным на основе 5-нм техпроцесса от TSMC с передовой технологией памяти и межсоединений, адаптированной для высокой пропускной способности и разнообразных форматов данных. Maia 100 предлагает разработчикам гибкость и переносимость через свой SDK, позволяя быстро разворачивать модели, написанные на PyTorch и Triton, при этом достигая эффективной обработки данных и производительности рабочей нагрузки.

19. OpenAI

OpenAI завершает разработку своего первого чипа ИИ совместно с Broadcom и TSMC с использованием 3-нм техпроцесса TSMC. Руководство команды разработчиков микросхем OpenAI имеет опыт проектирования TPU в Google и планирует начать массовое производство своих микросхем в 2026 году.

Кто еще производит ИИ-чипы

20. Graphcore

Graphcore — британская компания, основанная в 2016 году. Компания анонсировала свой флагманский ИИ-чип под названием IPU-POD256. Graphcore уже получила финансирование в размере около 700 млн. долларов. Компания имеет стратегические партнерства с такими корпорациями, занимающимися системами хранения данных, как DDN, Pure Storage и Vast Data. Чипы Graphcore обслуживают такие исследовательские институты, как Oxford-Man Institute of Quantitative Finance, University of Bristol и Berkeley University California. Долгосрочная жизнеспособность компании была под угрозой, поскольку она теряла около 200 млн. долларов в год, но в октябре 2024 года ее приобрел Softbank за более чем 600 млн. долларов.

21. Mythic

Mythic была основана в 2012 году и специализируется на периферийном ИИ. Mythic следует нетрадиционному пути — архитектуре аналоговых вычислений, которая направлена на обеспечение энергоэффективных периферийных вычислений ИИ. Компания разработала такие продукты, как M1076 AMP, MM1076 key card и т.д., и привлекла около 165 млн. долларов финансирования. В марте 2023 года Mythic уволила большую часть своих сотрудников и реструктурировала свой бизнес с помощью раунда финансирования.

Партнеры по производству и роль TSMC

Как ведущая в мире компания, занимающаяся литографическим производством, TSMC производит полупроводники на основе проектов клиентов, а не создает собственные чипы, что отличает ее от таких компаний, как NVIDIA и AMD. В то время как Samsung Foundry и Intel Foundry Services конкурируют в этой области, TSMC сохраняет технологическое преимущество. Ее передовые технологические процессы, в частности ее новаторские 5-нм и 3-нм техпроцессы, обеспечивают необходимое сочетание производительности и энергоэффективности, необходимые для передовых приложений ИИ.

TSMC стремится привлечь NVIDIA, AMD, Broadcom и Qualcomm для инвестирования в совместное предприятие по управлению литографическим подразделением Intel, сохраняя операционный контроль. Эта инициатива, поддержанная администрацией Трампа, появилась после того, как TSMC объявила о планах значительных инвестиций в США, а также направлена на возрождение Intel и укрепление производства чипов в США. Сделка сталкивается с трудностями из-за различий в процессах, но опирается на сильные стороны TSMC как ведущего литографического производства.

Производители ИИ-чипов в Китае

Поскольку санкции США помешали многим китайским компаниям приобретать самые передовые ИИ-чипы у AMD и NVIDIA, китайские компании увеличивают объемы закупок у местных производителей. Помимо Huawei и Alibaba, производством ИИ-чипов в Китае занимаются следующие компании:

- Cambricon фокусируется на оборудовании ИИ и ожидает продажи на сумму около 150 млн. долларов в этом году.

- Baidu использует чипы Kunlun в своем облаке и разрабатывает чип третьего поколения. Kunlun 2 сопоставим с NVIDIA A100.

- Biren, основанная бывшими сотрудниками NVIDIA, производит GPU BR106 и BR110.

- Moore Threads производит графические процессоры MTT S2000.

Статья подготовлена по материалам aimultiple.com, forbes.com, business-vector.info, businessinsider.com и других сетевых источников.