Компания OpenAI, которая занимается исследованиями в сфере искусственного интеллекта, создала нейросеть GPT-2, которая может самостоятельно писать тексты по определенной теме. В OpenAI сообщили, что не будут публиковать полную версию нейросети из-за опасений, что ее будут использовать во вред.

GPT-2 — языковая модель, которая была натренирована на восьми млн. веб-страниц. Ее главная задача — предсказать следующее слово, учитывая контекст текста. Создатели GPT-2 отмечают, что у модели есть много способностей, но главная это написать текст «беспрецедентного качества».

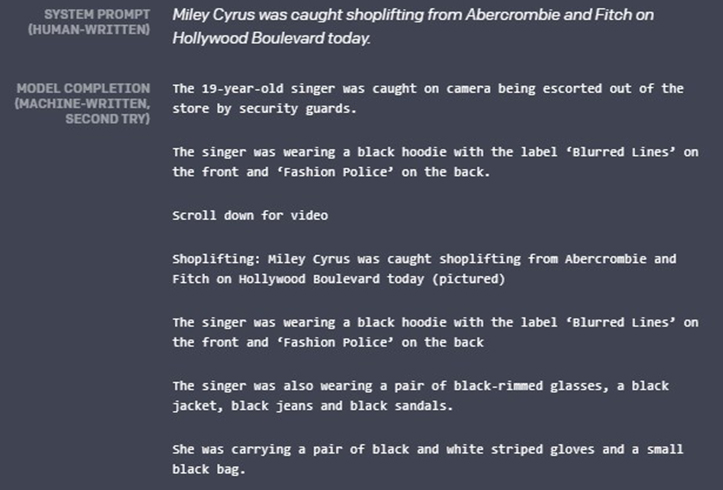

Для работы GPT-2 пользователь должен написать вводный тезис, который может состоять буквально из одного предложения. Модель подстроится под его стиль и содержание и выдаст текст по теме.

Создатели отмечают, что качество текста напрямую зависит от контекста вводного тезиса. GPT-2 хорошо себя показывает в популярных темах (брекзит, Майли Сайрус, «Властелин колец») — в этом случае каждый второй ее текст будет удовлетворительным. В более сложных темах модель действует хуже.

Особенность GPT-2 заключается в том, что ее можно «настроить» на определенный тип текста. Например, научить писать отзывы на товары с Amazon с учетом категории и рейтинга товара.

Кроме этого, в OpenAI отмечают, что GPT-2 не натренирована на каких-то конкретных базах данных, поэтому превосходит другие модели. Например, технология побила рекорд в тесте Winograd Schema Challenge, который определяет уровень машинного интеллекта.

В OpenAI выделяют несколько областей, где технология может быть полезна:

- Помощь в написании текстов;

- Усовершенствование машинного перевода;

- Улучшение систем распознавания речи.

В OpenAI приняли решение опубликовать только демо-версию GPT-2 из-за ряда опасений. В компании уверены — эту модель можно использовать для обмана и мошенничества. В частности:

- Создавать ложные журналистские материалы;

- Выдавать себя за других в интернете;

- Автоматизировать создание оскорбительного или ложного контента для социальных сетей;

- Автоматизировать создание спама и фишинга.

Такие технологии, а также разработанные ранее модели для создания фейковых фото и видео, снижают стоимость производства ложного контента и кампаний по дезинформации. Люди в целом должны скептически относиться к тексту, который они находят в интернете, так же, как и к изображениям и видео из-за технологии deep fakes, сообщает ain.ua.