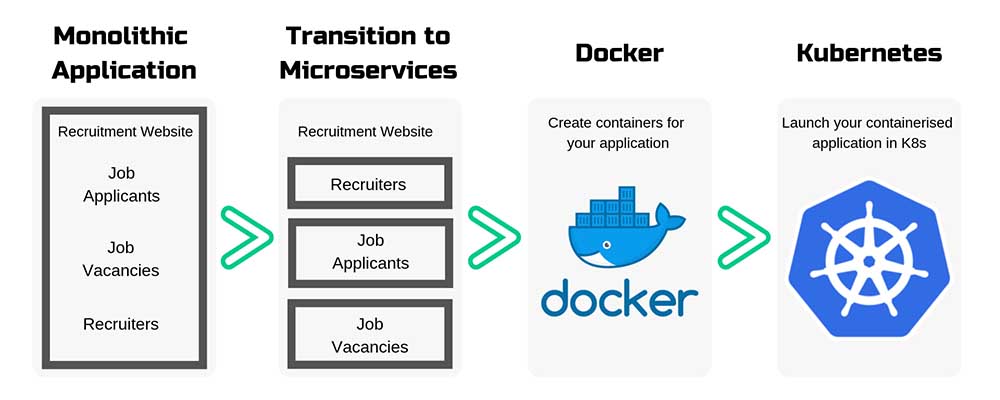

Контейнеризация и микросервисная архитектура радикально изменили подход к разработке и эксплуатации программных систем. Однако с ростом числа сервисов и контейнеров возникла новая задача — управление этой сложной инфраструктурой. Именно здесь ключевую роль сыграла платформа Kubernetes, которая за последние годы превратилась в фактический стандарт оркестрации контейнеров и основу большинства современных cloud-native-платформ. Сегодня Kubernetes используется как технологическими гигантами, так и стартапами, позволяя компаниям автоматизировать развертывание приложений, масштабировать инфраструктуру и поддерживать высокую отказоустойчивость систем.

От внутреннего проекта Google до индустриального стандарта

Платформа Kubernetes (или K8s) за последнее десятилетие стала центральным элементом современной cloud-native-инфраструктуры. Сегодня она используется для автоматизации развертывания, масштабирования и управления контейнеризированными приложениями в распределенных системах.

Название Kubernetes происходит от греческого слова «кормчий» — человек, управляющий кораблем. Это метафора, отражающая главную задачу системы: управление «флотом» контейнеров и сервисов. Kubernetes был представлен компанией Google в 2014 году. В основе проекта лежал многолетний опыт компании по управлению масштабными дата-центрами, прежде всего система Borg, которая использовалась внутри Google для оркестрации тысяч сервисов. Позже управление проектом было передано в Cloud Native Computing Foundation, где Kubernetes быстро превратился в ключевую технологию экосистемы cloud-native.

Kubernetes как операционная система дата-центра

Во многих публикациях Kubernetes называют «операционной системой для дата-центра». Подобно тому, как операционная система управляет ресурсами одного компьютера, Kubernetes управляет вычислительными ресурсами целого кластера серверов. Платформа распределяет вычислительные ресурсы между приложениями, автоматически перезапускает сервисы при сбоях и масштабирует инфраструктуру при росте нагрузки. Таким образом, Kubernetes берет на себя задачи, которые ранее выполнялись вручную системными администраторами.

Распространение технологии и рынок Kubernetes

Популярность Kubernetes напрямую связана с ростом облачных технологий и микросервисной архитектуры. По данным Cloud Native Computing Foundation, около 93% компаний по всему миру используют или тестируют Kubernetes, а сама технология занимает более 90% рынка систем оркестрации контейнеров.

Поддержку платформы обеспечивают крупнейшие технологические компании, включая Google, Amazon Web Services, Microsoft, Red Hat и Cisco. Вокруг Kubernetes сформировался огромный рынок инфраструктурных решений: облачные сервисы, корпоративные платформы, системы мониторинга, инструменты автоматизации и решения для безопасности.

Как устроена архитектура Kubernetes

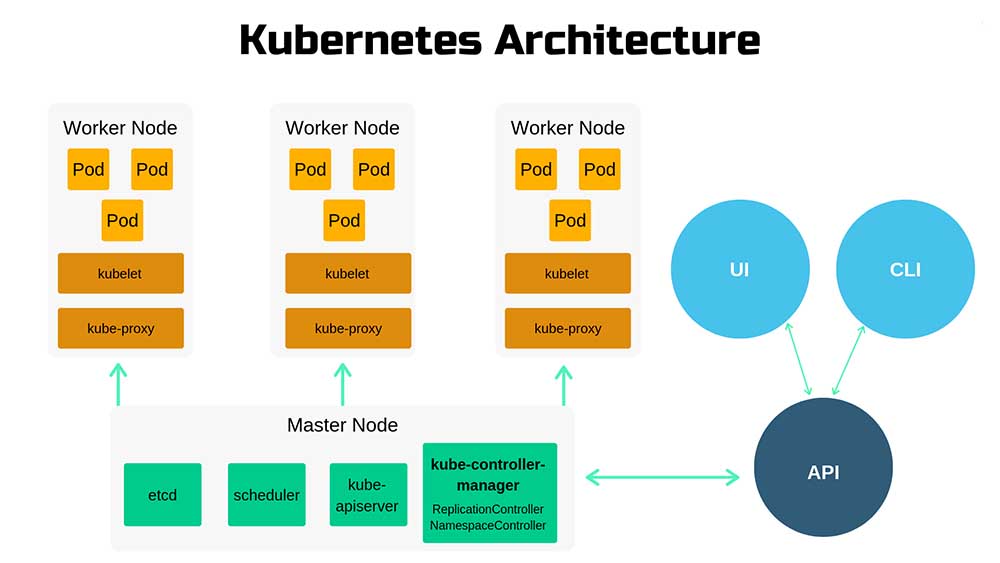

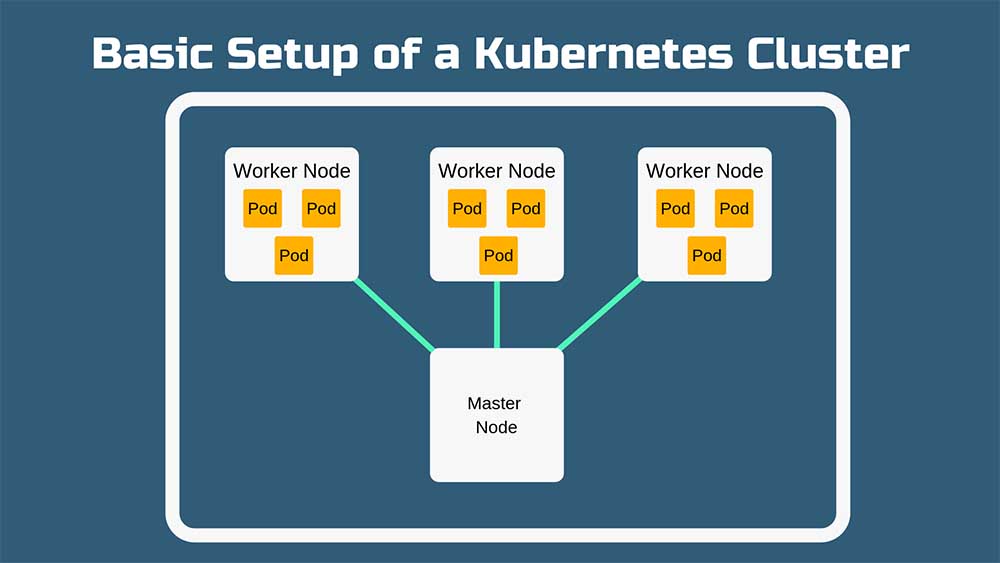

В основе Kubernetes лежит кластерная модель, при которой несколько серверов объединяются в единый вычислительный пул. Эти серверы могут быть физическими машинами, виртуальными инстансами или облачными ресурсами. Архитектура кластера разделена на два логических уровня. Первый — это Control Plane, управляющий слой, который принимает решения о работе системы и отслеживает ее состояние. Второй — Worker Nodes, вычислительные узлы, на которых запускаются контейнеры и выполняются приложения. Такое разделение ролей позволяет централизованно управлять инфраструктурой и автоматически распределять нагрузку между серверами.

Control Plane — «мозг» кластера

Control Plane отвечает за управление кластером и поддержание его состояния. Основным интерфейсом взаимодействия является API-сервер, через который проходят все операции — от запуска приложения до изменения конфигурации инфраструктуры. Вся информация о состоянии кластера хранится в распределенной базе данных etcd, которая выступает в роли единого источника истины для системы. Производительность этого хранилища напрямую влияет на скорость работы всей платформы, поскольку Kubernetes постоянно сверяет текущее состояние инфраструктуры с заданной конфигурацией.

Планировщик Kubernetes анализирует доступные ресурсы и определяет, на каком сервере следует запустить новый контейнер. При этом учитываются требования приложения, загрузка процессора и памяти, а также различные политики размещения. Отдельную роль играет Controller Manager — набор контроллеров, которые непрерывно следят за состоянием кластера. Если система обнаруживает расхождение между желаемым и фактическим состоянием, контроллеры автоматически исправляют ситуацию: перезапускают контейнеры, создают новые экземпляры приложения или заменяют недоступные узлы.

Рабочие узлы и выполнение приложений

Рабочие узлы — это серверы, на которых фактически запускаются контейнеры. Каждый узел содержит агент kubelet, который получает команды от Control Plane и управляет жизненным циклом контейнеров. Запуск контейнеров выполняет специальная среда исполнения — container runtime. На практике чаще всего используется Docker или более легкие runtime вроде containerd. За сетевое взаимодействие между сервисами отвечает компонент kube-proxy, который формирует сетевые правила и обеспечивает балансировку нагрузки внутри кластера.

Pod — базовая единица системы

Минимальной единицей развертывания в Kubernetes является Pod. Он представляет собой логическую группу контейнеров, которые запускаются на одном узле и используют общий сетевой стек. Хотя Pod часто содержит один контейнер, в некоторых случаях несколько контейнеров объединяются в один Pod для совместной работы, например, когда один контейнер выполняет основную бизнес-логику, а другой отвечает за логирование или проксирование сетевого трафика.

Сетевое взаимодействие и service mesh

В простых системах взаимодействие между несколькими Pod обеспечивается стандартными механизмами Kubernetes. Однако в сложных микросервисных архитектурах используется дополнительный инфраструктурный слой — service mesh. Service mesh представляет собой специализированную сетевую архитектуру, которая управляет коммуникацией между сервисами через прокси-компоненты. Этот уровень позволяет централизованно контролировать маршрутизацию трафика, безопасность соединений и наблюдаемость системы. Прокси-компоненты перехватывают сетевой трафик между сервисами, а управляющий слой координирует их работу. Такой подход позволяет внедрять функции вроде взаимной TLS-аутентификации, канареечных релизов и мониторинга без изменения кода приложений.

Экосистема Kubernetes: инструменты, без которых кластер не работает

Хотя Kubernetes обеспечивает базовую оркестрацию контейнеров, в production-среде он обычно используется вместе с целой экосистемой инструментов. Для управления сложными приложениями широко применяется Helm, который выполняет роль пакетного менеджера Kubernetes. С помощью Helm приложения распространяются в виде так называемых chart-пакетов, что значительно упрощает установку и обновление систем.

Наблюдаемость инфраструктуры обычно строится вокруг Prometheus, который собирает метрики кластера, и Grafana — используемого для визуализации данных и построения аналитических панелей. Автоматизация развертывания часто реализуется через подход GitOps. Одним из наиболее распространенных инструментов является Argo CD, который отслеживает изменения в Git-репозиториях и автоматически синхронизирует их с состоянием Kubernetes-кластера. Так формируется типичный технологический стек cloud-native-инфраструктуры, в котором Kubernetes выступает оркестратором, а остальные инструменты обеспечивают мониторинг, автоматизацию и управление конфигурациями.

Мультиоблачные и гибридные инфраструктуры

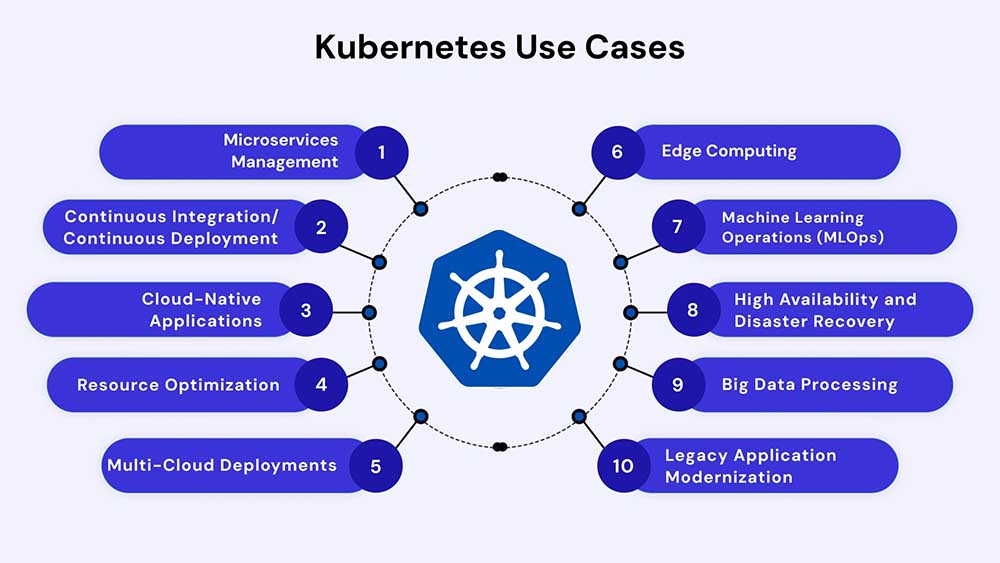

Одним из важных преимуществ Kubernetes является его независимость от конкретного облачного провайдера. Платформа может работать как в публичных облаках, так и в частных дата-центрах. Это делает Kubernetes ключевым инструментом для построения multi-cloud и гибридных инфраструктур, где приложения могут одновременно работать в нескольких облачных средах.

Управляемые Kubernetes-сервисы

Многие компании используют управляемые Kubernetes-платформы облачных провайдеров. Например, Amazon Web Services предлагает сервис Amazon Elastic Kubernetes Service, который берет на себя управление управляющей частью кластера. Компания Google развивает платформу Google Kubernetes Engine, а Microsoft предлагает сервис Azure Kubernetes Service. Такие решения позволяют компаниям сосредоточиться на разработке приложений, не занимаясь администрированием инфраструктуры.

Вендоры и платформы Kubernetes

Несмотря на то что Kubernetes является проектом с открытым исходным кодом, вокруг него сформировалась крупная индустрия коммерческих решений и платформ. Многие технологические компании предлагают собственные дистрибутивы Kubernetes, облачные сервисы и инструменты для управления контейнерной инфраструктурой. Одним из наиболее известных корпоративных решений является платформа Red Hat OpenShift, разработанная компанией Red Hat. Она представляет собой полноценную платформу для разработки и эксплуатации cloud-native-приложений на базе Kubernetes. OpenShift добавляет инструменты CI/CD, систему безопасности и интегрированное управление контейнерами, что делает платформу популярной в корпоративной среде.

Крупные облачные провайдеры также предлагают собственные управляемые сервисы Kubernetes. Например, Amazon Web Services предоставляет сервис Amazon Elastic Kubernetes Service, который берет на себя управление управляющей плоскостью кластера и значительно упрощает эксплуатацию инфраструктуры. Аналогичный сервис Google Kubernetes Engine предлагает компания Google, которая изначально разработала Kubernetes. В экосистеме Microsoft доступна платформа Azure Kubernetes Service, тесно интегрированная с облаком Azure.

Собственные решения для Kubernetes развивают и традиционные инфраструктурные вендоры. Компания Cisco предлагает платформу Cisco Intersight Kubernetes Service, предназначенную для управления Kubernetes-кластерами в гибридных и мультиоблачных средах. Система интегрируется с сетевыми и вычислительными решениями Cisco и позволяет централизованно управлять инфраструктурой контейнеров. На рынке также активно работают компании: VMware, предлагающая платформу VMware Tanzu; SUSE, развивающая корпоративный дистрибутив SUSE Rancher, который широко используется для управления Kubernetes-кластерами в гибридных инфраструктурах; Nutanix, предлагающая решение NKP (Nutanix Kubernetes Platform) для управления контейнерами, объединяющее облачные технологии и гиперконвергентную инфраструктуру.

Таким образом, вокруг Kubernetes сформировалась полноценная экосистема корпоративных платформ, позволяющих внедрять технологию как в публичных облаках, так и в частных или гибридных дата-центрах.

Реальные кейсы использования Kubernetes

Переход на Kubernetes позволил крупным технологическим компаниям значительно изменить подход к разработке и эксплуатации программных систем:

- Стриминговый сервис Netflix построил свою инфраструктуру вокруг микросервисной архитектуры и автоматизированных процессов развертывания. Благодаря этому компания может выполнять тысячи обновлений сервисов ежедневно без остановки платформы.

- Музыкальный сервис Spotify использует Kubernetes для управления тысячами микросервисов и автоматического масштабирования инфраструктуры. Это позволило значительно повысить эффективность использования вычислительных ресурсов.

- Платформа аренды жилья Airbnb применяет Kubernetes для координации работы сотен сервисов и поддержки масштабных DevOps-процессов внутри компании.

- Социальная сеть визуальных идей Pinterest использует Kubernetes для обработки огромных объемов пользовательских данных и рекомендаций.

Даже научные организации, такие как CERN, применяют Kubernetes для управления вычислительными задачами и обработки данных экспериментов.

Kubernetes и искусственный интеллект

Развитие систем искусственного интеллекта стало еще одним фактором роста популярности Kubernetes. Обучение ML-моделей требует огромных вычислительных ресурсов, включая GPU-кластеры. Kubernetes позволяет эффективно управлять такими инфраструктурами и распределять ресурсы между задачами. Поэтому многие ИИ-платформы и системы анализа данных строятся на базе Kubernetes.

Ограничения и проблемы Kubernetes

Несмотря на популярность, Kubernetes нельзя назвать простой технологией. Платформа обладает высокой архитектурной сложностью, поскольку она объединяет множество компонентов и требует глубокой экспертизы в области сетевой инфраструктуры, безопасности и распределенных систем. Дополнительные уровни инфраструктуры, например, service mesh, могут увеличивать задержки и потребление ресурсов, поскольку между сервисами появляется дополнительный слой сетевой обработки. Кроме того, управление Kubernetes-кластером требует продвинутых инструментов мониторинга, автоматизации и безопасности. Без этих компонентов эксплуатация системы становится трудоемкой и рискованной.

Почему Kubernetes стал стандартом

Популярность Kubernetes напрямую связана с бурным развитием облачных технологий и микросервисных архитектур. По данным Cloud Native Computing Foundation, Kubernetes стал одной из самых быстрорастущих инфраструктурных технологий в истории open-source. Сегодня его используют десятки тысяч компаний по всему миру, а количество проектов в экосистеме cloud-native превышает несколько сотен. Kubernetes автоматизирует управление инфраструктурой, обеспечивает высокую отказоустойчивость, позволяет масштабировать приложения практически без ограничений и не привязан к конкретному облачному провайдеру.

Фактически Kubernetes превратился в универсальный стандарт для управления контейнеризированными приложениями. В результате вокруг технологии сформировался огромный рынок инфраструктурных решений — от облачных сервисов и платформ разработки до инструментов мониторинга, безопасности и автоматизации DevOps-процессов.