Компания Amazon представила новую версию беспилотной машинки DeepRacer, которая позиционируется как платформа для изучения алгоритмов машинного обучения инженерами и программистами. Новая модель получила стереокамеру и лидар. Кроме того, компания добавит в заезды препятствия, а также разрешит заезды одновременно двух моделей.

Впервые о проекте AWS DeepRacer стало известно в 2018 году. В его рамках Amazon представила одноименную облачную платформу, позволяющая студентам и начинающим разработчикам создавать, обучать и испытывать на практике при помощи специального 3D-симулятора собственные наработки в сфере алгоритмов автономного вождения.

Также Amazon организовала две гоночные лиги — онлайновую и офлайновую. Онлайновая лига – для разработчиков, которые считают, что их алгоритм достаточно конкурентоспособен и они могут сравнить свои решения в виртуальных гонках. В офлайновой лиге алгоритмы соревнуются между собой уже в реальных заездах на фирменных машинках DeepRacer, которые в первой версии ездили лишь по простому треку, ориентируясь по данным с одной камеры.

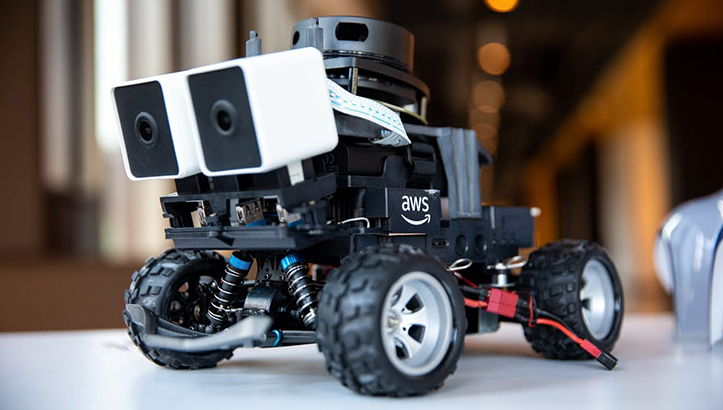

В новой версии Amazon представила машинку DeepRacer Evo с более сложным набором датчиков. Теперь она получает данные об окружающем пространстве с помощью двух камер, а также лидара на крыше. В начале 2020 года новая версия будет доступна в виде готового устройства, а также в виде набора датчиков, который можно будет установить на старую версию.

Разработчики добавили в соревнования новые режимы. Раньше участники соревновались в скорости прохождения трека во время одиночных заездов, теперь благодаря наличию всестороннего лидара они смогут соревноваться напрямую во время заездов с участием двух машин. На трассе появятся препятствия, которые машинкам необходимо будет обнаруживать и объезжать. Кроме того, Amazon увеличила число реальных гонок в разных странах до 30 и число виртуальных до 24 и объявила о создании инструмента, который позволит всем желающим создавать собственные локальные гоночные мероприятия.

Сейчас проводятся заключительные тестовые заезды, а уже в 2021 году будут проводиться соревнования без участия профессиональных пилотов.